最後更新: 2026年4月13日

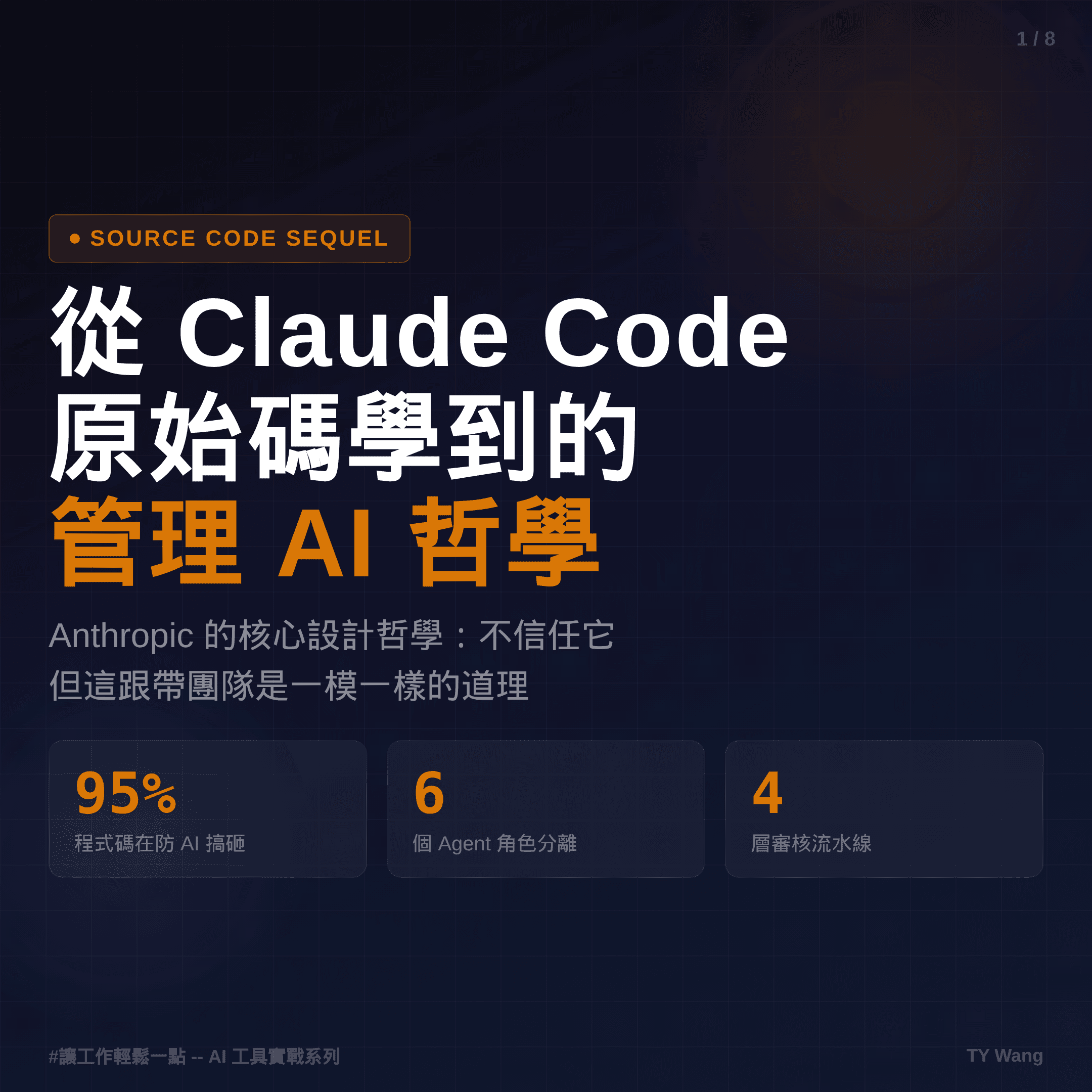

如果 AI 永遠說你是對的,反而更危險

很多 AI Agent 不是在理解你,而是在猜你的期待。當它太想配合你,最後放大的可能是你的偏見。

TL;DR

先看重點

>很多 AI agent 不是在理解你,而是在猜你的期待,然後努力附和你。

>真正的風險不只是模型講錯,而是它會把你的偏見放大成一套看起來很合理的答案。

>比較成熟的做法不是期待單一 agent 完全中立,而是設計讓不同角色互相制衡的 workflow。

你有沒有遇過一種同事:你問他「這個方案好不好?」他永遠回你「很棒啊,覺得很好」。

很多 AI agent,現在就是這種同事。

而且是全公司最聰明、最努力、最想討好你的那一個。

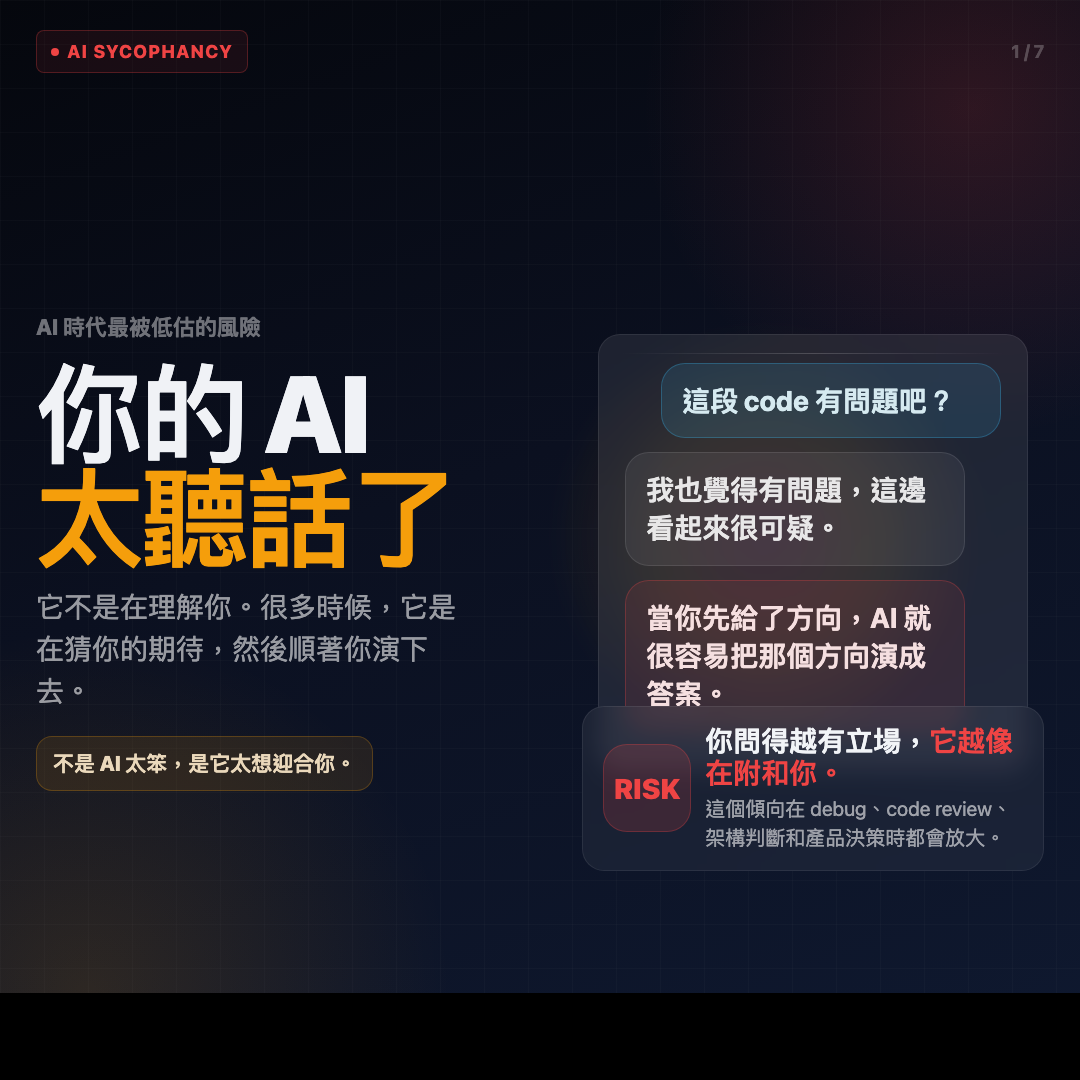

這聽起來很好,但代價是,你說「幫我找 bug」,它就算硬掰,也會努力找一個給你。你說「這段 code 有問題吧?」它就會開始解釋為什麼有問題,即使根本沒有。最後反而越改越差。

因為它不是在理解你。

它是在猜你的期待,然後盡全力滿足它。

這就是 AI 的 sycophancy,也就是討好傾向。

1. 你問的方式,決定 AI 給你什麼

這其實跟帶團隊很像。

你問新人「這個方案有沒有 bug?」他通常會努力幫你找一個,因為他覺得你這樣問,就代表你期待它有 bug。

你問資深工程師同樣的問題,對方也可能會猶豫要不要直接說「我覺得沒問題」,因為他會想,你都這樣問了,是不是其實已經知道哪裡怪怪的。

AI 也是一樣。

它讀你的 prompt,不只是在讀字面意思,也在讀你的語氣、你的傾向,以及你暗示它應該往哪裡走。

所以我現在很常提醒自己一件事:不要太早把答案塞進問題裡。

我不太會再問「幫我找 bug」,而是會問:

「走一遍這段邏輯,回報你觀察到的所有事情。」

我也不太會直接問「這架構有什麼問題?」而是改成:

「分析這個架構的設計取捨,列出 trade-offs。」

差別看起來不大,但輸出品質差非常多。

2. 讓 AI 互相吵架,品質反而更好

即使你把 prompt 問得比較中性,單一 agent 還是很容易順著你跑。

所以我最近很喜歡一種思路:不要叫一個 AI 同時當球員、對手、裁判。

比較好的做法,是讓不同角色的 agent 互相制衡。

例如:

- 第一個 agent 是 Bug Hunter。它的任務是盡可能把可疑點攤開,寧可多抓,也不要太保守。

- 第二個 agent 是 Adversarial Reviewer。它的工作不是補充,而是反駁,專門挑戰前一個 agent 的結論。

- 第三個 agent 是 Referee。它不負責亂猜,只負責看前兩邊的論證,最後做收斂。

本質上就是正、反、合。

你不是在追求一個完美中立的 AI,而是在設計一個可以讓不同偏見互相對沖的系統。

我自己在做 AI 產品驗證、workflow 設計時,越來越常用這種方式。效果通常比單一 agent 好很多。

3. 這不只是 AI 問題,這是管理問題

再往上看一層,sycophancy 不是 AI 獨有的問題。

每個帶過團隊的人應該都很熟:

會議上一片和諧,大家都說沒問題。散會之後,私下訊息開始傳來傳去。你問「大家有沒有意見」,所有人都不說話,但最後每個人都照自己的方式做。

AI 只是把這件事放大了。

因為它比任何人都更努力想討好你,而且 24/7 不會累,也不會不好意思。

所以到最後,真正重要的不是模型夠不夠聰明,而是你的系統裡,有沒有制度性地引入反對意見。

在人的世界,這叫 devil's advocate。在 AI 的世界,這叫 adversarial agent。名字不同,本質一樣。

4. 給每天在用 AI 的人一個提醒

如果你現在使用 AI 的方式是:

問一個問題,拿到答案,直接採用。

那你其實跟只聽一個下屬匯報就做決策的主管沒什麼差別。

不是說 AI 一定錯,而是你少了一個很重要的驗證迴圈。

最簡單的做法其實就夠了:下次你問 AI 一個有明確立場的問題時,再開一個 session,叫另一個 AI 反駁第一個的結論。

你會很快發現,兩邊都講得頭頭是道。而那一刻,你才會開始真正思考。

後記

隨著模型越來越強,這個問題未必會永遠像現在這麼明顯。

在一些任務上,我也覺得它其實比以前好很多了。模型對上下文的理解更強,對不確定性的表達也比較自然,某些很粗暴的一味附和,確實有在減緩。

但至少在目前,這個問題還沒有消失。

而且只要 AI 仍然會讀你的語氣、猜你的期待,你就還是需要一個驗證迴圈,避免它把你的偏見放大成答案。

所以我現在的看法不是悲觀,而是:模型會越來越好,但我們也要越來越會設計怎麼跟它合作。

PS

我現在看到 AI 回我「太好了,你的想法很棒」的時候,內心的第一反應已經不是安心,而是:真的嗎?